易翻译年报以产品为中心,围绕四大核心能力(文本翻译、语音实时互译、拍照取词、双语对话)和100+种语言覆盖,系统回顾了过去一年在用户场景落地、技术演进与运营实践上的要点。本文用尽量通俗的方式讲清楚“它是怎样工作的、为谁服务、做得如何、还有什么要改进”,并给出可操作的思路与现实约束,便于产品经理、开发者与企业用户快速把脉与决策。下面就一步步把各方面拆开说清楚——像和朋友聊产品一样,偶尔有点即兴。

一、产品定位与价值主张

定位:一个覆盖全场景的随身翻译工具,目标是让不同语言的人在学习、工作、旅行、商务等情境中能“开口就懂、看就明白”。

核心价值:用最少的操作成本、最快的响应时间,把语言障碍变成可控的转换问题;同时尽量保护用户隐私与使用流畅度。

为什么这个定位切得准

- 语言服务不是单一功能,而是组合体验:识别(听/看)、理解(翻译引擎)、呈现(文本/语音交互)三部分都要好。

- 用户场景多样:从机场换登机牌、课堂听讲到国际会议同传,单一技术无法覆盖所有体验点,需要产品化整合。

- 可扩展性是商业可持续的前提:开放SDK、企业版与订阅制可以支撑长期投入。

二、四大核心功能拆解(用费曼法:把复杂的事讲给新手)

文本输入翻译:先识别意图,再给最可读的译文

把它想象成两步走:一是“理解原文”,二是“把理解用目标语言表达得好”。技术上是分词/解析 + 神经机翻(NMT) + 后处理(格式、专有名词)。

- 适用场景:学习笔记翻译、邮件草稿、网页摘录。

- 用户关心:准确度、专业词汇、术语一致性、格式保持。

- 实现要点:领域适配(医学、法律、技术)、用户词典、翻译记忆。

语音实时互译:要求低延迟与高容错

语音实时互译要解决三件事:听懂(ASR)、理解(意图/上下文)、说出(TTS 或文本呈现)。差错可以累积,所以要把延迟、回退策略、噪声抑制做得好。

- 关键技术:端侧降噪、流式ASR、低延迟NMT、分段合成。

- 体验设计:显示原语与译语并列、支持手动纠错、对话模式记忆上下文。

拍照取词翻译(OCR + 翻译):场景感强,边用边学

拍照取词看起来简单,难点在于多字体、多角度、排版复杂时的识别率,以及如何把识别的词片段拼成有意义的句子再翻译。

- 特点:强交互:用户常常需要选中某段文字并立即获得译文和发音。

- 优化点:版式识别、字符修复、局部上下文重构。

双语对话翻译:把翻译嵌入真正的交流流

这是最“社交”的功能,既要兼顾实时性,也要保证语气、礼貌用语不被机器翻译得生硬。并且要处理多人会话、轮次管理和话者区分。

- 设计考虑:短句优先、打断处理策略、翻译回退(原文优先显示)

- 场景举例:旅游问路、跨国商务谈判、国际课堂小组讨论。

三、技术架构与研发亮点

把底层抽象成三层:感知层(ASR/OCR)、理解层(NLP/NMT)、呈现层(UI/TTS/交互)。这样好理解,也方便迭代。

感知层(听与看)

- ASR:采用流式模型与端云协同策略,关键是噪声鲁棒和普通话/方言切换。

- OCR:结合传统图像预处理与轻量Transformer用于文字识别,多语言版式适配。

理解层(翻译引擎)

- NMT:对常见语对使用大模型,低资源语对用跨语言迁移与回译增强。

- 后处理:命名实体保护、数字与表格格式化、用户词典插值。

呈现层(交互与部署)

- 实时翻译强调端侧缓存与流式输出,避免“等一整句话才出结果”的卡顿感。

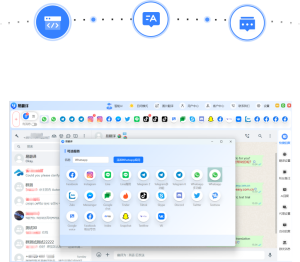

- 支持iOS/Android/Web三端一致的交互语言与快捷操作。

| 功能 | 核心技术 | 体验目标 |

| 文本翻译 | 神经机翻 + 领域自适应 | 准确、保持格式与术语一致 |

| 语音互译 | 流式ASR + 低延迟NMT + TTS | 延迟低、容错高 |

| 拍照取词 | 图像预处理 + OCR + 语境重建 | 识别率高、操作自然 |

| 双语对话 | 多轮对话管理 + 话者识别 | 连贯、有礼貌、支持多人 |

四、用户与市场(产品如何落地)

说到用户,我会把他们粗略分成几类:个人用户(学生、旅行者)、职场用户(跨境团队、外企员工)、企业用户(客服国际化、会议翻译)、平台合作方(旅游平台、教育机构)。

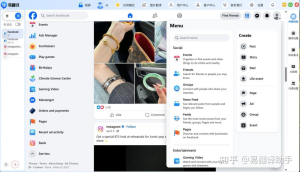

典型使用场景

- 旅行:机场、餐馆、酒店前台的即时沟通。

- 学习:外文文献摘读、课堂听写与讨论。

- 工作:国际邮件草拟、跨国视频会议的口头同步。

- 商务:合同术语核对、现场谈判时的快译。

商业模式

- 免费+订阅(高级功能、离线包、批量API调用)。

- 企业版/定制服务(SLA、行业术语库、私有部署)。

- SDK/白标合作(嵌入旅游、教育平台)。

五、运营与关键指标(如何判断好坏)

判断一个翻译类产品是否健康,要看“留存、使用频次、场景覆盖与商业转化”四个维度。下面是一些常用指标与观察点,供运营和决策参考。

- 日活/月活(DAU/MAU):看核心功能的黏性,语音互译和拍照取词通常推动短期活跃。

- 人均会话时长/次:反映真实沟通需求的深度。

- 功能转化率:例如从免费用户转化到付费订阅,或API接入量。

- 错误率/回退率:ASR识别错误、翻译被用户手动更改的比例,直接影响口碑。

| 指标 | 观察点 |

| 留存率 | 场景覆盖是否吻合用户核心痛点 |

| 付费转化 | 高级功能是否真正带来商业价值(离线、API、定制) |

| 用户满意度 | 真实沟通成功率与客服反馈 |

六、数据安全与合规

这块不能马虎。语言数据里往往包含个人敏感信息或商业秘密,处理方式要明确、可审计。

- 分级存储:临时缓存本地、长期数据经加密上传并做脱敏处理。

- 按需上云/本地化部署:为企业客户提供私有化部署选项,满足行业合规。

- 透明的隐私政策与用户控制:给用户关闭云同步、删除历史记录的入口。

七、真实案例(小故事说明问题)

这里讲两个短小的用户场景,说明产品是怎么被用到的,也说明了它的极限在哪里。

案例一:旅行中的救急

某用户在海外机场行李丢失,通过语音实时互译与工作人员沟通,快速确认行李编号与联系方式。过程里ASR在嘈杂环境下有两次误识,但靠着短句分段翻译和手动校正,最终完成沟通。说明:实时翻译能显著降低沟通摩擦,但噪声与命名实体仍是薄弱点。

案例二:课堂助教

一位外语老师使用拍照取词功能,将英文讲义快速翻译成中文段落,再在课堂上即时修正术语。结果学生理解力提高、课堂互动更多。说明:OCR+文本翻译在学习场景价值极高,尤其是需要保留格式和上下文时。

八、存在的挑战与改进方向(诚实点说)

- 低资源语言的质量差距:数据稀缺使模型不够鲁棒,需要利用跨语言迁移和合成数据。

- 噪声环境下ASR的鲁棒性:需要更好的降噪策略与多麦克风支持。

- 实时性 vs 质量的权衡:更长上下文能提升质量,但会增加延迟,产品层面要做更巧妙的分段策略。

- 隐私与商业化的冲突:企业客户要私有化部署,但这增加运维与成本。

九、路线图(接下来可以怎么做)

如果我是产品负责人,我会把接下来的工作分为三条并行线,短中长期都有落地计划:

- 短期(3-6个月):提升ASR在噪声下的召回率、优化拍照取词的布局识别、推出更明确的付费包(离线包)。

- 中期(6-12个月):完善行业术语库与企业词典、推出企业私有化部署方案、建立翻译记忆库支持团队协作。

- 长期(12个月以上):探索多模态理解(结合图像场景信息改进翻译)、增强低资源语种能力、研究更自然的双向会话代理。

十、最后的一点思考(像是边写边想)

说到这里,有件事我一直在想:语言服务的终极目标,应该不是把每句话都“翻译正确”,而是让人们在一种最少摩擦的状态下完成交流。技术可以尽量降低误解的概率,但真正的信任建立还靠产品把流程做得顺手、可控。这意味着,除了算法上的进步,用户体验的小细节、商业模型的透明、以及与现实场景的贴合,都是决定一个翻译产品能否长期存在的关键。

好啦,随手把这些点记下来,写得有点像边喝咖啡边做笔记的感觉。要是你想让我把某一部分(比如技术实现细节、商业化模型或某个场景的量化数据)展开成单独的深度版年报,我可以继续把那部分拆得更细一点,补上更多示例和操作建议。