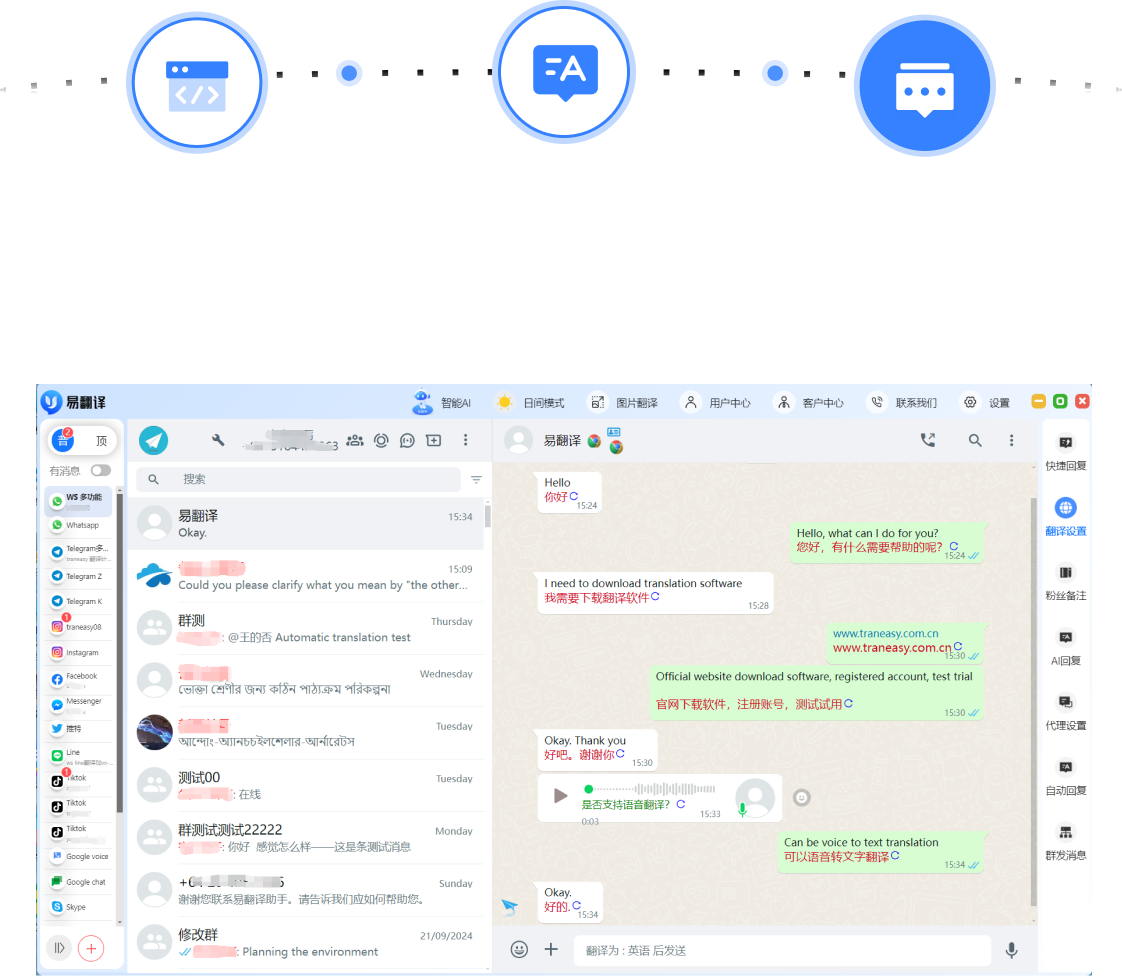

易翻译把文字、语音、拍照和对话四种输入打通,靠语种识别、神经机翻、语音识别/合成和OCR四大模块协作,在云端与设备端分工、流式传输和上下文缓存下实现实时互通,用户只需选场景或开自动检测,系统就能把多模态信息统一为连贯可编辑的翻译。并支持离线包、术语表与实时纠错,保证速度和一致性。兼顾隐私与加密可选。

先把复杂说清楚:一句话如何互通

想象一下,把“听得见的声音”、拍下的“图片”、你输入的“文字”都丢到同一个翻译厨房里,厨师会先认出食材(语种或文字),再用最合适的配方(模型)料理,最后把一道菜(翻译)端给你。这就是易翻译互通的思路:识别→转换→整合→输出。每一步都有专门的技术和策略,让不同输入能“说同一门语言”。

把每个模块拆开来讲(费曼式)

1. 语种识别(Language Identification)

做什么:先确认你说的是哪种语言、方言或混合语句。像分拣站,把不同包裹送到对应轨道。

- 为什么必须:很多功能(比如选择ASR模型或MT引擎)依赖正确语种。

- 常用方法:短时间窗口特征+轻量神经网络或统计方法,实时判断并回填置信度。

2. 语音识别与合成(ASR/TTS)

做什么:把声音转成文字(ASR),或把文字读成自然语音(TTS)。

- ASR用端到端或分层(声学模型 + 语言模型)方式,实时流式解码,支持回声消除和噪声鲁棒。

- TTS把翻译结果变成可懂的语音,常用神经网络合成保证流畅度和情感。

3. 光学字符识别(OCR / 图像文字识别)

做什么:把照片或相机取词里的文字识别出来,包括印刷体、手写体和复杂排版。

- 预处理(去畸变、增强)→文本检测(定位)→文本识别(解码)→后处理(语言检查、纠错)。

- 与翻译互通关键在于把识别出的文本附带位置信息(行列)和字体/格式元数据,便于还原与编辑。

4. 神经机器翻译(NMT)与术语管理

做什么:把一种文字变成另一种文字,尽量保留语义和上下文。

- 主流用Transformer类模型做端到端翻译,分云端大模型和设备端轻量模型。

- 术语表、翻译记忆(TM)与短期上下文缓存保证一致性:专有名词不会忽然变译法。

模块如何“互通”:技术与工程的接缝

互通并不是把模块堆在一起,而是把它们用“接口”和“协议”无缝连接,好比把厨房的炉灶、刀具、调料架用传送带和菜谱串起来。

1. 数据格式统一

所有模块用共同的中间格式(例如带时间戳的JSON或Protobuf),包含:原始输入、检测到的语种、置信度、时间/位置标记、上下文id。这样任何模块都能读取并接着处理,不会丢信息。

2. 流式传输与消息队列

实时场景(同声传译、双语对话)采用流式传输(WebSocket / gRPC streaming)。短时间内的语音帧、识别结果和翻译结果像一条河流,边到边处理,延迟控制在可听范围。

3. 上下文管理(Context)

互通的灵魂是在多个模块之间共享短期上下文:会话id、最近几句的文本、命名实体列表。这样OCR识别出的人名可在后续ASR识别或MT翻译中被优先保留。

4. 术语表与翻译记忆的统一调用

术语表在翻译前被注入为约束或偏好;翻译记忆提供历史翻译的参考。系统会在翻译请求里附带当前会话的术语偏好,确保多模态输入一致性。

云端与设备端如何分工

互通的稳定性和隐私来自“边缘+云”的混合策略:

- 设备端:负责轻量ASR、离线翻译包、简单OCR与预处理,保证断网或延迟情况下的基本服务。

- 云端:运行大型NMT模型、复杂的多模态融合、长期翻译记忆和统计学习,用于提升质量与学习迭代。

- 优化点:关键是决定哪些数据上云、哪些留在本地(比如敏感会话可以选择全本地模式)。

典型用户场景:一步步看清楚互通怎么发生

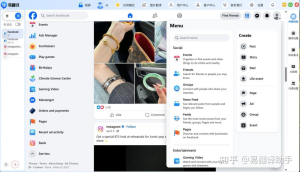

场景A:旅游时的即时语音+拍照互通

- 你对着商店说一句话,系统ASR转文字→语种识别确认目标语→NMT翻译并TTS返回;

- 你拍下菜单,OCR识别→把文字加入当前会话上下文→如果菜单里有专有菜名,术语表注入优先翻译,翻译结果可以跟语音结果共享同一术语表,避免矛盾。

场景B:商务会议的双语对话模式

- 双方话语分别进入不同ASR流,系统做说话人标注(speaker diarization);

- 每句被实时翻译并推送到对方设备,同时会话缓存记录术语和上下文,保证后面引用同一概念用同一译法;

- 会后系统把对话文本、两种语言的时间对齐结果导出,便于归档或审校。

实际工程要点(再细说):延迟、错峰、回退

把系统搭成“看起来无缝”的背后,有很多工程技巧:

- 低延迟解码:ASR采用分段解码并输出部分假设(partial hypotheses),MT支持增量翻译,TTS可以边合成边播放。

- 错峰与批处理:云端在高峰时把非实时任务排到批处理,优先保障实时会话。

- 回退策略:若云端不可用,自动切换到离线模型;若ASR置信度低,提示用户重说或展示候选项。

安全与隐私:数据如何被保护

互通的过程中,数据在本地、传输、云端都可能暴露,易翻译一般采用这些做法:

- 传输层加密(TLS),服务间使用认证与权限控制(OAuth、API key);

- 敏感会话可选择“端侧处理+不上传”模式,或上传时做脱敏/匿名化;

- 日志与模型训练采用差分隐私或样本采样,术语表和用户词典默认私有;

- 合规:遵循当地隐私法规与企业合规要求(类似GDPR原则)。

对用户的操作指南:如何把互通用好

- 开启自动语种检测:省事又准确,系统会自动选择最合适的ASR/MT管线。

- 上传或维护术语表:商务或专业场景强烈推荐,保证多次对话一致。

- 优先使用实时模式:同声传译或对话场景选“流式”以减少等待。

- 遇到噪声或方言:把麦克风靠近说话人,或切换到拍照取词与文字输入结合使用。

- 离线包准备:出国前下载目标语离线包,遇到断网还能保持基本互通能力。

常见问题与排查小贴士

- 翻译不一致:检查是否启用了不同的术语表或多个会话并行。

- 识别率低:尝试提高录音质量、减少背景噪声或切换方言模型。

- 延迟高:查看网络状况,或启用设备端离线模式。

- OCR抽取错误:确保拍照对齐、光线充足,或手动框选识别区域。

一个表格:模块与互通点速览

| 模块 | 主要功能 | 与其他模块的互通点 |

| 语种识别 | 判定语言/方言 | 驱动ASR/MT选择,标注OCR识别语言 |

| ASR | 声音→文字 | 提供MT输入;输出带时间戳供对齐与TTS |

| OCR | 图片→文字 | 把文本加入会话上下文,优先术语匹配 |

| NMT | 文本翻译 | 读取ASR/OCR输出 + 术语表 + 上下文缓存 |

| TTS | 文字→语音 | 播放NMT输出,支持语音风格调整 |

局限与未来方向(说得直白些)

目前互通系统在专业术语、罕见方言、多说话人重叠发言时仍有挑战。未来会朝这些方向走:

- 更强的多模态融合模型,能同时读图、听声、读文本并生成更连贯输出;

- 更小但更聪明的本地模型,减少隐私顾虑并提升离线体验;

- 更深的个性化(根据用户偏好和历史自动调整译法)。

最后像跟朋友说一句话

如果你平时用易翻译,记得把场景选对、术语表准备好、出门前下好离线包——这些小动作能让“互通”真正变成你体验中的顺手和省心。系统在后台做了很多复杂的协调,但对你来说,应该就是一句话:能听会看,会记得你刚才说过的那句话,还能把它流畅地翻成另一种语言。好了,就到这儿,随用随调、慢慢试就好了。